沈阳自动化所多篇论文获CVPR2026录用

近日,中国科学院沈阳自动化研究所机器人学研究室机器智能研究组关于偏振图像处理、跨模态迁移学习、3D目标检测、多智能体协同追踪、具身智能操作的系列研究成果被计算机视觉领域国际学术会议CVPR 2026正式录用。

论文题目:Polarization State Tracing for Reflection Removal and Color-Consistent Reconstruction,第一作者为博士生王冬悦,通讯作者为田建东研究员。

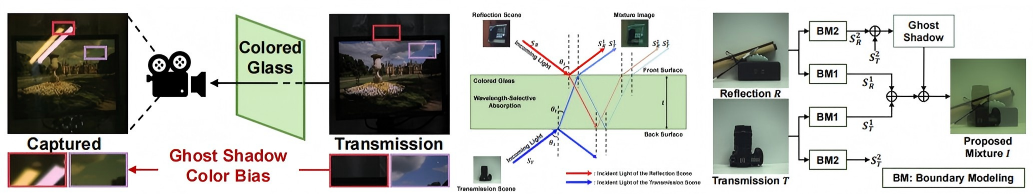

经过彩色玻璃捕获的照片存在严重的色偏和鬼影,研究团队针对这一现象,考虑玻璃的选择性吸收,提出被忽略的彩色玻璃降解问题。基于偏振成像理论,首次对全流程偏振光的传输进行建模,建立偏振状态追踪模型(PSTM),并提出了一种基于物理的窗口环形通道注意力机制。

彩色玻璃降解问题与提出的偏振状态追踪模型

论文题目:Decoupled and Reusable Adaptation for Efficient Cross-Modal Transfer ,第一作者为博士生刘雅静,通讯作者为田建东研究员。

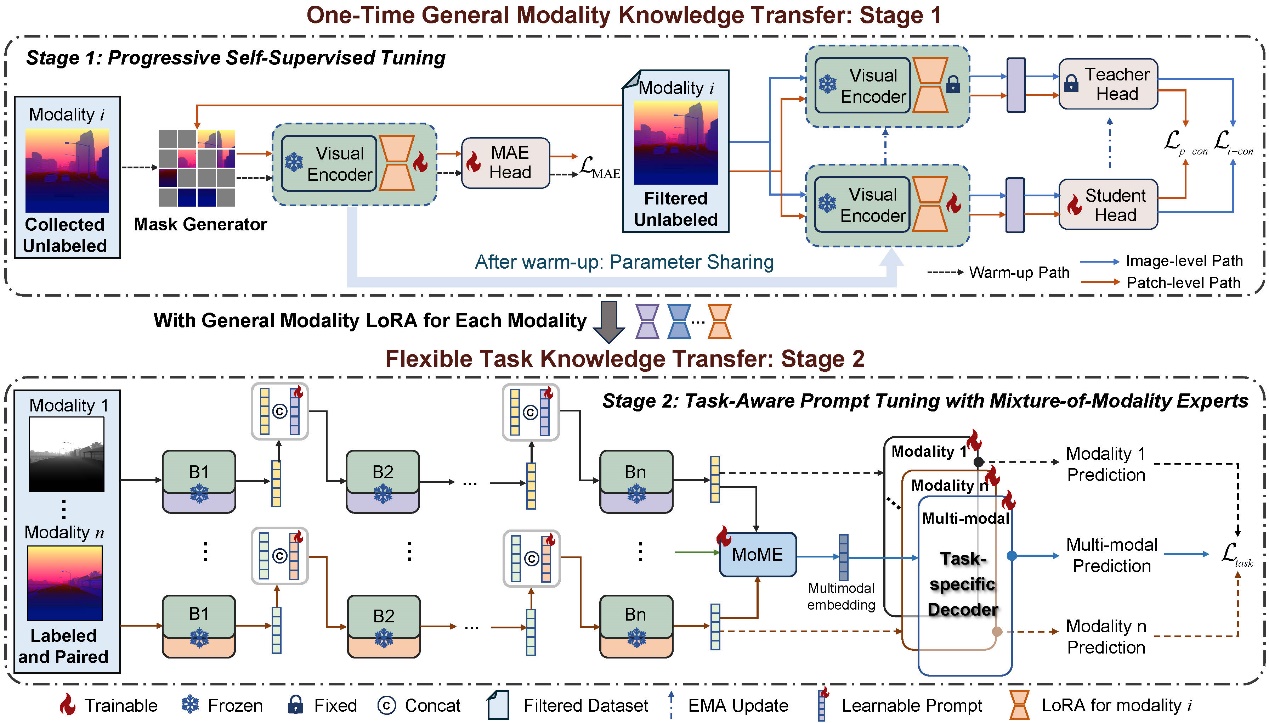

研究团队针对跨模态迁移中换任务需重复训练、存储冗余的问题,提出高效跨模态迁移框架,将迁移过程解耦为一次性通用模态知识迁移与灵活轻量任务知识迁移。该框架利用无标注数据完成一次性预训练,生成可跨任务复用的模态LoRA,在多种下游场景中显著提升了任务适配的数据、计算与存储效率。

高效跨模态迁移学习框架

论文题目:GMT: Effective Global Framework for Multi-Target Multi-Camera Tracking,第一作者为硕士生甄奕豪,通讯作者为范慧杰研究员。

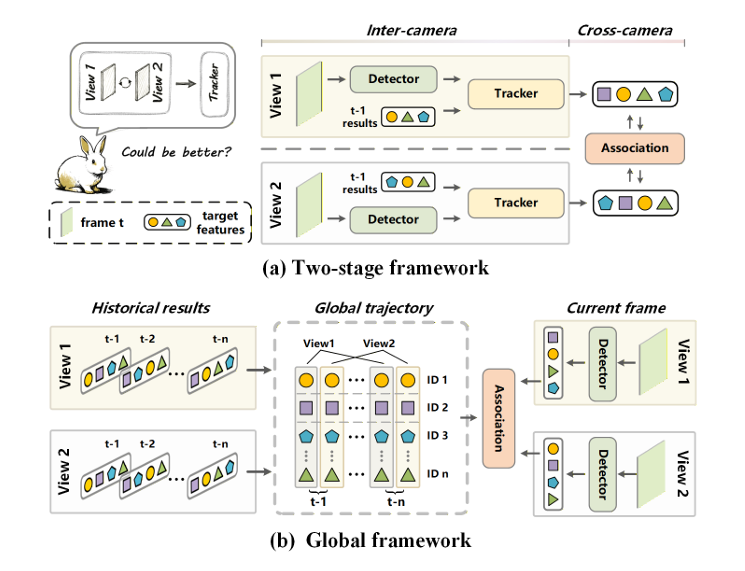

研究团队针对现有二阶段多智能体协同追踪(MCMT Tracking)范式对多视角信息利用不充分的问题,提出了全局追踪框架(Global MCMT Tracking Framework)。该框架通过将来自不同智能体的本地轨迹编码为全局轨迹,将追踪问题重构为全局轨迹-目标的匹配问题,实现了在追踪过程中直接利用多视角信息的目的。

全局多智能体协同追踪框架

论文题目:STUR3D: Spatio-Temporal Unified Representation Learning for 3D Object Detection,第一作者为范慧杰与联培生黄鹏瑞,通讯作者为王强副教授。

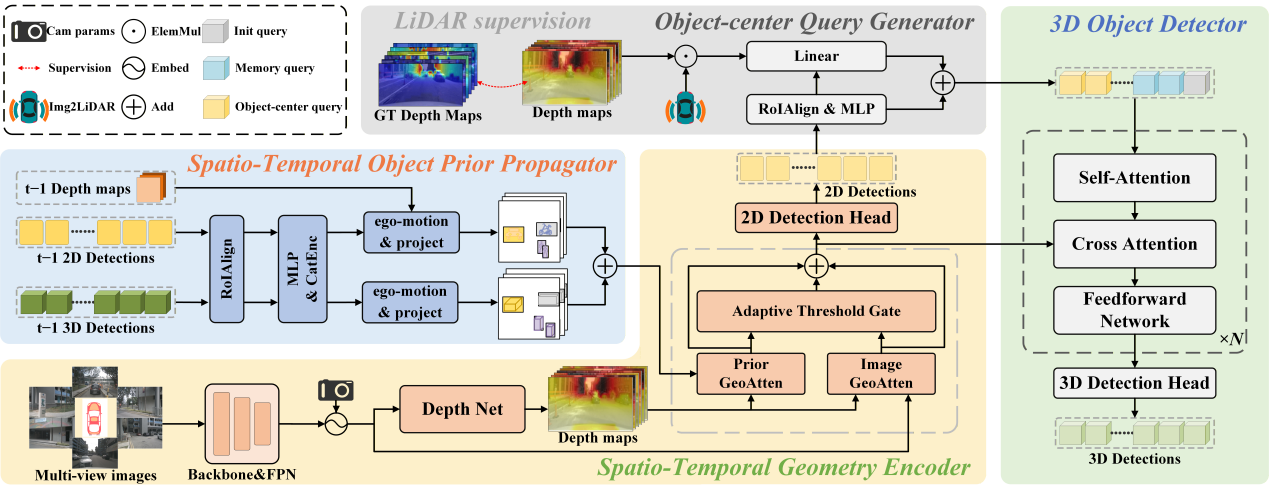

研究团队针对现有环视3D检测器过度依赖当前帧2D信息而导致的时空表征不一致及遮挡下目标易丢失等问题,提出了时空统一表征学习框架STUR3D。该框架创新性地引入了时空物体先验传播模块,通过显式融合历史检测结果、注入深度感知的几何先验,推进2D与3D感知间的时空对齐,显著增强了系统在动态及遮挡场景下的检测稳定性与定位精度。在nuScenes测试集上达到57.9%mAP和64.6% NDS的顶尖性能,有效解决了现有2D-to-3D流水线中的性能瓶颈。

时空统一表征学习

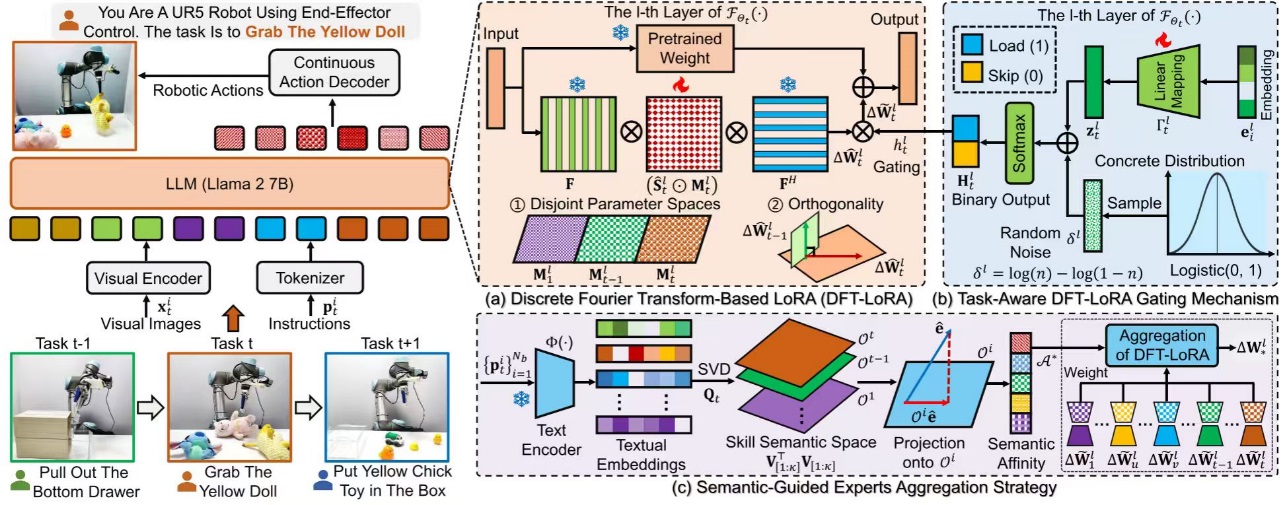

论文题目:Continual Vision-Language Action Learning in Robotic Manipulation,第一作者为董家华博士与博士生王旭东,通讯作者为韩志研究员。

研究团队聚焦多任务场景下机器人操作持续学习的核心挑战,提出了全新的持续VLA(视觉-语言-动作)任务学习框架LISA。基于该框架,机器人将连续操作任务的知识表征在离散傅里叶空间中,使机器人能够在不断掌握新操作技能的同时稳固已有能力,有效缓解持续学习过程中的灾难性遗忘问题,显著提升操作的泛化性。

机器人视觉语言动作操作持续学习框架

IEEE国际计算机视觉与模式识别会议(IEEE/CVF Conference on Computer Vision and Pattern Recognition, CVPR) 是计算机视觉领域公认的顶级学术会议,属于中国计算机学会(CCF)A类会议。(机器人学研究室)

附件下载: